Объемы данных растут быстрее, чем скорость их обработки

Сегодня кто-то просто обязан изобрести новый способ работы компьютеров – отличный от тех программируемых электронных машин, которые доминировали с 1950 года. В противном случае мы либо получим наводнение данными, которые просто не сможем использовать, либо в конечном счете нам придется строить дата-центры размером с Москву, которые будут потреблять столько энергии, что им будут нужны собственные АЭС.

Сегодня кто-то просто обязан изобрести новый способ работы компьютеров – отличный от тех программируемых электронных машин, которые доминировали с 1950 года. В противном случае мы либо получим наводнение данными, которые просто не сможем использовать, либо в конечном счете нам придется строить дата-центры размером с Москву, которые будут потреблять столько энергии, что им будут нужны собственные АЭС.

Серьезно, Вы хотите, чтобы у Google был собственный ядерный потенциал?

Увеличивающийся разрыв между данными и вычислениями объясняет, почему IBM в июле заявил, что собирается инвестировать $3 млрд на исследования в области новых видов компьютерных процессоров. Это также помогает понять, почему D-Wave, крошечная канадская компания, работает над созданием квантовой вычислительной техники (что на первый взгляд кажется настолько же правдоподобным как и то, что бекон растет на деревьях) объявила о получении финансирования в $28 млн от Goldman Sachs, венчурной компании Draper Fisher Jurvetson из Силиконовой долины и Банк Развития Бизнеса Канады.

Рано или поздно IBM или D-Wave или другой выскочка собирается изобрести компьютерную версию реактивного самолета, после чего все другие компьютеры по всему миру вдруг покажутся поездами.

Взрыв данных – это уже вчерашние новости. Поместите 3 миллиарда человек в Интернет, смешайте с бумом мобильных приложений и датчиками, встроенными во все, что только можно, и тщательно перемешайте. Вы получите смесь, которая генерирует так много данных, что их номенклатура будет звучать так, будто она была заимствована из фантастических фильмов. Сегодняшние зетабайты становятся завтрашними йоттабайтами, а послезавтра у нас появятся, например, суперпупербайты.

Это было бы нормально, если бы компьютеры могли не отставать и обрабатывать возрастающие потоки данных своевременно. Но они не могут. Одна из проблем заключается в компьютерных процессорах, которые совершают всю обработку. В течение 50 лет технологи были в силах сделать чипы меньше, плотнее и быстрее. Закон Мура, который работает больше как предложение, чем как неоспоримый закон природы, отметил, что производительность чипа может удваиваться каждые 18 месяцев или около того. Пока что он остался верен, компьютерная техника двигалась в авангарде и опережала наши требования к ПК.

Но теперь мы уменьшили чипы почти до их физических пределов, всего нескольких атомов в ширину. А если чипы не станут меньше и плотнее, компьютеры не смогут становиться быстрее и мощнее с теми темпами, к которым мы привыкли. И с этой токи зрения, если попытаться сделать чипы еще меньше и плотнее, они просто исчезнут.

Другой проблемой является фундаментальная архитектура почти всех современных компьютеров, впервые описанная в 1950 году математиком Джоном фон Нейманом. В архитектуре фон Неймана компьютерные программы и данные хранятся отдельно, и программы «вытягивают» данные, чтобы обработать их в соответствии с пошаговой инструкцией, совершая в один момент одно действие, как в линейном математическом уравнении.

Компьютеры сегодня могут выполнять эти инструкции за наносекунды, но они все еще делают один шаг за один раз, что стало помехой, известной как «бутылочное горло» фон Неймана. Если отдельные микросхемы больше не смогут стать быстрее, а объем работы, который компьютеры должны выполнять продолжит расти, единственным способом борьбы с все более крупными проблемами обработки данных с помощью программируемых компьютеров фон Неймана будет создание все большего количества компьютеров и как никогда больших центров обработки данных.

Серийная архитектура компьютеров не имеет ничего схожего с архитектурой мозга (и, конечно, далеко не так эффективна). Мозг хранит данные и инструкции по их обработке вместе, и постоянно перепрограммирует себя (то есть, обучается). Он обрабатывает большие объемы материала в одно и то же время, а не поэтапно, и все это с использованием крохотного заряда электроэнергии. Даже фон Нейман незадолго до своей смерти признавал и писал о контрасте между его архитектурой и архитектурой мозга, и предположил, что будущим компьютерам все-таки придется работать как мозг.

Большую часть своих трехмиллиардных инвестиций IBM собирается направить на развитие подобных мозгу чипов и архитектуры. Компания финансирует исследования в этой области уже в течение нескольких лет, способствуя грандиозному проекту под названием Synapse (Системы Нейроморфной Адаптации Вычислительной Электроники), который финансируется американскими военными. Несколько других компаний и университетов, также содействуют Synapse.

Цель, поставленная перед Synapse – создание компьютерного чипа, который может действовать как мозг со 100 млн нейронов. То есть создание процессора, который находится где-то между мозгом крысы, с его 55 млн нейронов, и мозгом кошки, с его 760 млн нейронов. И все же это еще далеко от человеческого мозга, который может похвастать 20 000 000 000 нейронов (минус потери от отключений в барах после текилы).

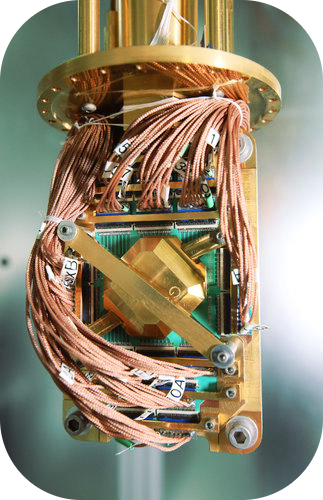

D-Wave приводит иное решение проблемы «бутылочного горла» фон Неймана. Лаборатории по всему миру работают над квантовыми вычислениями. D-Wave является одной из немногих компаний, которые уже обещают коммерциализировать его. Основная идея заключается в использовании особенностей квантовой физики, чтобы получить атомы, производящие расчеты. Десяток атомов в квантовом компьютере сделает его более мощным, чем крупнейший суперкомпьютер в мире.

D-Wave приводит иное решение проблемы «бутылочного горла» фон Неймана. Лаборатории по всему миру работают над квантовыми вычислениями. D-Wave является одной из немногих компаний, которые уже обещают коммерциализировать его. Основная идея заключается в использовании особенностей квантовой физики, чтобы получить атомы, производящие расчеты. Десяток атомов в квантовом компьютере сделает его более мощным, чем крупнейший суперкомпьютер в мире.

Все это является многообещающим, но остается основная проблема с квантовыми или подобными мозгу компьютерами: они все еще лишь лабораторные проекты. Квантовый прототип компьютера D-Wave, возможно, не такой уж квантовый, как и Бэтмен не такой уж супергерой, так как у него в действительности нет сверхспособностей. Проект Synapse находится еще на расстоянии нескольких лет до воспроизведения мозга крысы. Математики еще даже не знают, как писать алгоритмы, которые используют преимущества одновременной обработки данных, обещанной в обучаемых и квантовых компьютерах. Руководитель IBM Research Джон Келли часто говорит, что, основываясь на сегодняшней научной работе, истинные когнитивные и квантовые компьютеры выйдут в свет раньше, чем ожидалось, но речь все равно идет о нескольких десятилетиях или даже больше.

В то же время, если тенденции развития данных и вычислительных мощностей продолжат двигаться в нынешних направлениях, мы в конечном итоге либо задохнемся в огромном потоке данных или будем похоронены под ЦОДами. Китай уже строит центр обработки данных, втрое превышающий размер любого ЦОДа в США. По размерам он будет таким же, как Пентагон.

Так что появление одного из сверхтребовательных потребителей энергии размером с Москву уже, считайте, в прошлом.